معرفی پردازنده گرافیکی H200

فهرست مطالب:

Toggleتحلیل و بررسی تخصصی NVIDIA H200: قلب تپنده دیتاسنترهای مدرن هوش مصنوعی

در عصری که هوش مصنوعی مولد (Generative AI) و مدلهای زبانی بزرگ (LLM) مرزهای دانش را جابجا میکنند، زیرساخت سختافزاری تنها یک «ابزار» نیست؛ بلکه «مزیت رقابتی» است. پردازنده گرافیکی H200، بر پایه معماری انقلابی Hopper، پاسخی است به نیاز شرکتهایی که به دنبال عبور از محدودیتهای پردازشی نسل قبلی هستند.

ما در شرکت بهاور فناوری ویرا، با درک چالشهای تامین سختافزارهای استراتژیک در بازار داخلی، این تکنولوژی سطحبالا را برای سازمانها و مراکز داده در ایران تامین و پشتیبانی میکنیم.

معماری Hopper و جهش به سوی حافظه HBM3e

پردازنده H200 نسخه تکاملیافته H100 است. در حالی که قدرت پردازش خام (TFLOPS) در هر دو مدل تقریباً یکسان باقی مانده، انویدیا در H200 بر روی بزرگترین گلوگاه سیستمهای AI تمرکز کرده است: حافظه.

این اولین پردازندهای است که از حافظه HBM3e استفاده میکند.

-

ظرفیت حافظه: افزایش از ۸۰ گیگابایت به ۱۴۱ گیگابایت.

-

پهنای باند: افزایش از ۳.۳ ترابایت بر ثانیه به ۴.۸ ترابایت بر ثانیه.

این جهش به معنای آن است که مدلهای بسیار بزرگ (مثل Llama-3 یا GPT-4) اکنون میتوانند حجم بیشتری از پارامترها را مستقیماً روی GPU نگه دارند، که نتیجه آن کاهش تأخیر (Latency) و افزایش خیرهکننده سرعت پاسخدهی (Inference) است.

مزایای پردازنده گرافیکی H200

-

سرعت استنتاج (Inference) دوبرابری

در تستهای عملی بر روی مدل Llama2 70B، پردازنده H200 تا ۲ برابر عملکرد بهتری نسبت به H100 نشان داده است. برای کسبوکارهایی که سرویسهای آنلاین مبتنی بر هوش مصنوعی ارائه میدهند، این یعنی پاسخدهی سریعتر به کاربر نهایی با هزینه کمتر.

-

کاهش TCO (هزینه کلی مالکیت)

اگرچه H200 یک محصول ردهبالا و گرانقیمت است، اما به دلیل بهرهوری انرژی بالاتر و توانایی اجرای بارهای کاری سنگینتر روی تعداد GPU کمتر، در مقیاس صنعتی باعث صرفهجویی در فضای دیتاسنتر، برق و سیستمهای خنککننده میشود.

-

سازگاری بینظیر (Drop-in Compatibility)

یکی از بزرگترین مزایای H200 برای مشتریان بهاور فناوری ویرا، سازگاری آن با پلتفرمهای موجود است. H200 از همان فرمفاکتورها و زیرساختهای HGX H100 استفاده میکند. این یعنی شما بدون نیاز به تغییر در طراحی سرورها یا سیستمهای خنککننده، میتوانید زیرساخت خود را ارتقا دهید.

بیشتر بخوانید:

مفهوم GPU، مشخصات، انواع و کاربرد

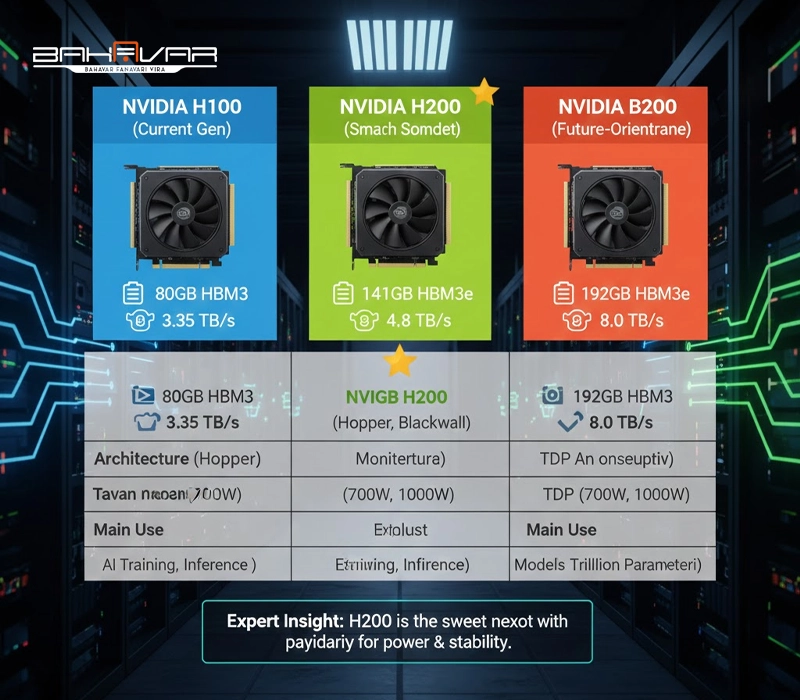

جدول مقایسهای: H100 vs H200 vs B200

برای انتخاب دقیق، باید بدانید در کجای نقشه راه تکنولوژی ایستادهاید:

| ویژگی | NVIDIA H100 (نسل فعلی) | NVIDIA H200 (انتخاب هوشمند) | NVIDIA B200 (آیندهنگرانه) |

| معماری | Hopper | Hopper (بهینه شده) | Blackwell |

| حافظه (VRAM) | 80GB HBM3 | 141GB HBM3e | 192GB HBM3e |

| پهنای باند حافظه | 3.35 TB/s | 4.8 TB/s | 8.0 TB/s |

| توان مصرفی (TDP) | 700W (SXM) | 700W (SXM) | 1000W |

| کاربرد اصلی | آموزش عمومی AI | استنتاج مدلهای بزرگ و HPC | آموزش مدلهای تریلیون پارامتری |

نکته کارشناسی: H200 در حال حاضر «نقطه طلایی» بازار است؛ چرا که قدرت نسل بعدی را با پایداری و سازگاری نسل فعلی ترکیب کرده است.

کاربردهای استراتژیک H200 در ایران

-

پردازش زبان طبیعی (NLP): آموزش و بومیسازی مدلهای زبانی فارسی که به حافظه گرافیکی بسیار بالایی نیاز دارند.

-

کشف دارو و بیوتکنولوژی: شبیهسازیهای مولکولی در مراکز تحقیقاتی که پهنای باند حافظه در آنها حرف اول را میزند.

-

تحلیل دادههای بزرگ (Big Data): پردازش بلادرنگ دادههای مالی و بانکی با استفاده از هستههای Tensor.

-

دولت الکترونیک و امنیت: پیادهسازی سیستمهای بینایی ماشین در مقیاس شهری.

کالبدشکافی فنی: چرا حافظه HBM3e بازی را تغییر داد؟

در دنیای پردازش، مفهومی به نام «دیوار حافظه» (Memory Wall) وجود دارد. یعنی پردازنده سرعت بسیار بالایی دارد اما چون حافظه نمیتواند با همان سرعت دادهها را به آن برساند، پردازنده بیکار میماند.

در H200، استفاده از HBM3e فقط یک ارتقای عددی نیست. این حافظه نسل جدید با مصرف انرژی کمتر، پهنای باند ۴.۸ ترابایت بر ثانیه را فراهم میکند. برای متخصصین IT این یعنی:

-

تراکم بالاتر در مدلهای زبانی: شما میتوانید مدلهایی با پارامترهای بیشتر را روی کلاسترهای کوچکتر اجرا کنید.

-

کاهش جابجایی داده: وقتی داده بیشتری در حافظه محلی GPU جای میگیرد، نیاز به فراخوانی داده از RAM سیستم (که بسیار کندتر است) کاهش یافته و کل چرخه پردازش سریعتر میشود.

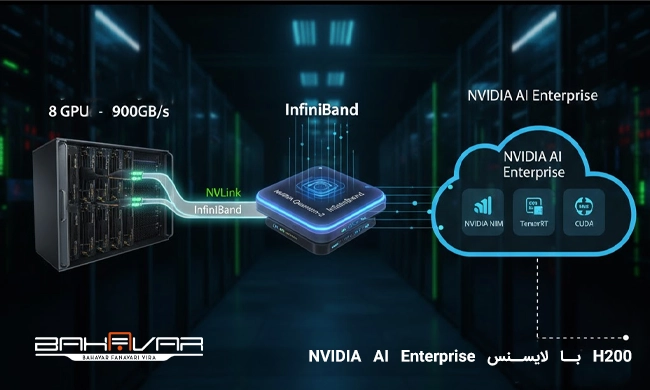

زیرساخت شبکه و اهمیت NVLink نسل چهارم

خرید یک کارت H200 به تنهایی کافی نیست. برای اینکه قدرت واقعی این پردازنده در شرکت شما شکوفا شود، سیستم ارتباطی بین کارتها حیاتی است. در پلتفرمهایی که بهاور فناوری ویرا ارائه میدهد، از تکنولوژی NVLink استفاده میشود که اجازه میدهد تا ۸ عدد GPU در یک نود (Node) با سرعت ۹۰۰ گیگابایت بر ثانیه با هم صحبت کنند. این یعنی از دید نرمافزار، شما یک ابر-پردازنده با بیش از ۱ ترابایت حافظه گرافیکی یکپارچه دارید.

نقش InfiniBand در کلاسترهای H200

اگر سازمان شما به بیش از یک سرور (مثلاً ۴ یا ۸ سرور) نیاز دارد، ما راهکارهای شبکه NVIDIA Quantum-2 InfiniBand را پیشنهاد میدهیم. بدون این شبکه پرسرعت، خروجی کارتهای H200 در ترافیک شبکه سنتی (Ethernet) هدر میرود.

بررسی تخصصی نرمافزار و پشته NVIDIA AI Enterprise

سختافزار بدون نرمافزار صرفاً یک قطعه سیلیکون گرانقیمت است. H200 با لایسنس NVIDIA AI Enterprise سازگاری کامل دارد که شامل:

-

NVIDIA NIM: میکروسرویسهایی برای استقرار سریع مدلهای هوش مصنوعی.

-

TensorRT: بهینهساز موتور استنتاج که در H200 به دلیل معماری حافظه جدید، راندمان خیرهکنندهای دارد.

-

CUDA 12 به بالا: بهرهگیری از تمامی قابلیتهای جدید مدیریت حافظه.

ما در بهاور فناوری ویرا، علاوه بر تامین سختافزار، در حوزه پیکربندی این لایههای نرمافزاری نیز مشاور شما خواهیم بود تا مطمئن شویم سختافزار شما با حداکثر توان زیر بار میرود.

تحلیل پایداری و سیستم خنککننده (Thermal Management)

یکی از دغدغههای اصلی مدیران زیرساخت، دفع حرارت ۷۰۰ واتی هر کارت H200 است.

-

در مدلهای PCIe: نیاز به کیسهای Rackmount با فنهای دور بالا و فشار هوای مثبت است.

-

در مدلهای SXM: استفاده از سیستمهای Direct-to-Chip (DTC) یا خنککننده مایع توصیه میشود.

تیم فنی ما در زمان خرید، چکلیستی از الزامات محیطی (دما، رطوبت و توان برق ورودی) را به شما ارائه میدهد تا از بروز مشکلاتی مثل Thermal Throttling (کاهش خودکار سرعت به دلیل دما) جلوگیری شود.

راهنمای خرید برای مدیران مالی و IT

چرا باید به جای مدلهای ارزانتر، روی H200 سرمایهگذاری کرد؟

-

طول عمر تکنولوژی: H200 تا سالها در صدر جدول باقی میماند و دیرتر مستهلک (از نظر تکنولوژیک) میشود.

-

تراکم پردازشی: به جای خرید ۲۰ سرور معمولی، با خرید ۵ سرور مجهز به H200، همان قدرت را با هزینه نگهداری بسیار کمتر به دست میآورید.

-

پشتیبانی از مدلهای آینده: با بزرگتر شدن مدلهای هوش مصنوعی در سالهای ۲۰۲۶ و بعد از آن، کارتهای ۸۰ گیگابایتی عملاً از رده خارج میشوند، اما ۱۴۱ گیگابایت حافظه H200 فضای تنفس کافی را به شما میدهد.

خرید H200 از بهاور فناوری ویرا

تامین سختافزارهای حساس مانند سری Hopper انویدیا، نیازمند تخصص فنی و زنجیره تامین مطمئن است. شرکت بهاور فناوری ویرا فراتر از یک فروشنده، به عنوان بازوی فنی شما عمل میکند:

-

تامین مستقیم: ارائه راهکارهای SXM و PCIe متناسب با نیاز زیرساختی شما.

-

مشاوره کانفیگ: متخصصین ما به شما کمک میکنند تا بین سرورهای ۴-GPU یا ۸-GPU بر اساس بودجه و نیاز پردازشی، بهترین انتخاب را داشته باشید.

-

گارانتی و پشتیبانی: نصب، راهاندازی و اطمینان از سلامت کالا در شرایط دیتاسنتری.

-

تامین سیستمهای مکمل: ارائه کارتهای شبکه پرسرعت (Infiniband) و سوئیچهای NVLink برای جلوگیری از گلوگاههای شبکه.

سناریوهای استقرار

- سناریوی اول (Cloud Provider): اگر قصد فروش سرویس ابری (GPU as a Service) دارید، H200 به دلیل قابلیت Multi-Instance GPU (MIG) به شما اجازه میدهد هر کارت را به ۷ بخش مجزا تقسیم کرده و به مشتریان مختلف اجاره دهید.

-

سناریوی دوم (Enterprise AI): برای شرکتهایی که دادههای حساس دارند و نمیخواهند از APIهای خارجی استفاده کنند، راهاندازی یک کلاستر داخلی با H200 امنترین و سریعترین راه است.

سخن پایانی

به عنوان یک متخصص IT، توصیه من این است: اگر پروژه شما در مرحله تحقیق و توسعه (R&D) کوچک است، شاید مدلهای پایینتر کفایت کند؛ اما اگر به دنبال عملیاتی کردن هوش مصنوعی در سطح سازمانی و پاسخگویی به هزاران کاربر همزمان هستید، H200 انتخاب نهایی شماست.

انویدیا H200 صرفاً یک ارتقای سختافزاری نیست؛ بلکه کلید ورود به دنیای هوش مصنوعی مولد در ابعاد تجاری است. اگر به دنبال افزایش بهرهوری تیمهای Data Science خود هستید و میخواهید هزینههای پردازش ابری را با مالکیت سختافزار کاهش دهید، H200 بهترین گزینه روی میز است.

ما در بهاور فناوری ویرا آمادهایم تا جلسات فنی حضوری جهت بررسی نیازهای دقیق دیتاسنتر شما برگزار کنیم. با کارشناسان ما در ارتباط باشید.

آیا H200 نیاز به خنککننده مایع دارد؟

در مدلهای SXM5 و در کلاسترهای پر تراکم، سیستمهای مایع (Liquid Cooling) توصیه میشوند، اما برای بسیاری از کاربردها، سیستمهای Air-cooled استاندارد نیز با مدیریت صحیح جریان هوا پاسخگو هستند.

تفاوت نسخه PCIe و SXM چیست؟

نسخه PCIe برای سرورهای استاندارد مناسبتر است، در حالی که نسخه SXM (استفاده شده در پلتفرم HGX) بالاترین پهنای باند ارتباطی بین GPUها را فراهم میکند و برای خوشههای پردازشی سنگین طراحی شده است.